汎用人工知能

これは 人工知能アドベントカレンダー の25日目の記事です。

最終日です。ここまで紹介してきた情報を元にして、汎用人工知能を作るために必要な理論と技術をあらためて見ていきましょう。

脳全体のモデル

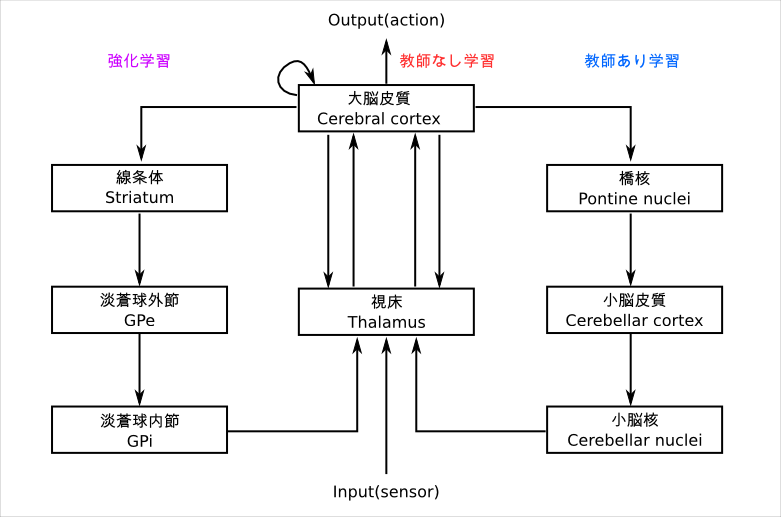

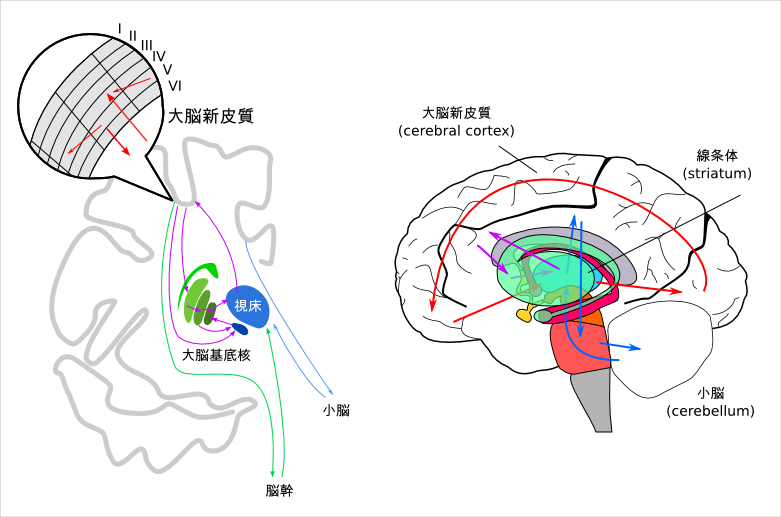

比較的よく見られるものを紹介します。まず、脳をおおまかに大脳(大脳新皮質)・大脳基底核・小脳にわけて、それぞれ以下のアルゴリズムをベースにモデル化します。

大脳→教師なし学習

小脳→教師あり学習

大脳基底核→強化学習

kazoo04.hatenablog.com

kazoo04.hatenablog.com

主な役割としては、

- 大脳基底核は快不快を元にして、自分にとって最も利益があるような行動を選ぶことを担当します。

- 大脳は外界から得た複雑に変化する情報を整理して、本質的な情報、高次の情報を抽出します。

- 小脳は教師あり学習できるようなものを担当して外界を含めた内部モデルの学習をします。

理論によって差はありますが、概ね上記の3つを当てはめたものが多いようです。わかりやすいですし、単純化しすぎている感じもしますがそれなりに説得力があります。

大脳のモデル

大脳新皮質のモデルとしては、 Slow Feature Analysis *1を使ったものや、Topographic Independent Component Analysis *2を使ったもの、TICAを応用して一次感覚野の位相マップを説明するもの*3などがあります。低次領野の一部しか説明できていませんが、高次の領野についてはより多くの生理学的な知見が必要になるでしょう。

TICAによって得られた視覚野と聴覚野の再現。一次感覚野に限定すれば、すでにそれなりの結果が得られていることがわかる*4

共通しているのは、教師なし学習を行うという点です。知能の高い動物は、本能だけでなく生まれた後に「学習」することでより生存率を高めています。外界のことをなにも知らないので、わからないものから有用な情報を抽出する必要があります。大脳は学習に非常に時間がかかるものの、比較的頑健な情報を教師なしで抽出することが得意なようです。

小脳のモデル

小脳のモデルは、既に見てきた小脳パーセプトロン仮説をベースにしたものが支配的で、教師あり学習によって内部モデルを獲得することを目的とします。小脳は最初は乱雑に接続されているだけなので学習がまったくできていない状態ですが、任意の関数を近似でき、かつ大規模な並列計算によって高速に処理できるという特徴があるので、大脳新皮質から情報を送って小脳で処理した結果を受け取る、といったこともしています。まさにCPUに対するGPU的な位置づけですね。

アルゴリズムとしては、Perceptron *5*6や Liquid State Machine*7*8をベースに構築したものが多いようです*9*10*11。

より実践的なモデル

それぞれのアルゴリズムはわかりましたが、具体的にはどのような仕組みになっているのでしょうか。小脳と大脳基底核はすでに色々な説を紹介しましたが、大脳新皮質についてはより細かいモデルも提案されています。

Hierarchical Temporal Memory (HTM)

HTM は Numenta の Jeff Hawkins が提案しているモデル*15で、視覚・聴覚・体性感覚・言語といった様々なモジュールがピラミッドのような階層的な接続で構築されているものです。

HTMは、時系列データを主眼においており、入力されてきた時々刻々と変化する信号を観察し、同じような並びのデータが来たらそれを一つのグループとしてまとめる*16ことでより抽象的なデータになっていく、と考えます。

Jeff Hawkins は 「考える脳 考えるコンピューター」 という本を出しており、その中でもHTMのアーキテクチャについて解説しているのですが、残念ながら今は中古本しか手にはいらないようです。脳科学や機械学習を全く知らなくても楽しく読める本なので、機会があれば是非ご一読ください。

- 作者: ジェフ・ホーキンス,サンドラ・ブレイクスリー,伊藤文英

- 出版社/メーカー: ランダムハウス講談社

- 発売日: 2005/03/24

- メディア: 単行本

- 購入: 15人 クリック: 141回

- この商品を含むブログ (106件) を見る

BESOM

BESOMは産業技術総合研究所の一杉裕志が提唱しているモデルです。これもモジュールが階層構造をなしているという点は同じです。基本的なアイディアとしては、Self Organized Maps (SOM) と Independent Component Analysis (ICA) をベースとしたモジュールで情報抽出を行い、さらにベイジアンネットワークを用いてネットワークを構築するという方法です。

興味のある方は日本語の資料が沢山公開されているので調べてみてください。

Information Integration Theory (情報統合理論, IIT)

IITは、ジュリオ・トノーニ(Giulio Tononi)が提案している理論で、上で紹介したものとは趣向が異なり、意識そのもののモデルです*18。

異論はいろいろあるのですが、意識を直接数学的なモデルにしようという試みは今までにないものなので、妥当性は別としても大きな注目を集めています。IITは日本ではまだマイナーな存在なので、ここでは簡単に概要を説明します。IITの論文では、これから述べるようなぼんやりとしたものではなく、数学的な手順を踏んだ論理的なものになっているので、気になった方は論文をご覧ください。

IITを理解する上でのポイントは(筆者の考えでは)3つあり、「情報」、「(情報の)統合」、「統合情報量」がわかればなんとなく全体像が掴めると思います。

IIT - 情報

IITは頻繁に information (情報) という単語が出てきますが、ここでの情報は普段使われる情報とはやや異なります。

IITにおける情報とは、システムの内的な情報(intrinsic information) のことだけを指します。つまり、外界がどうなっているか、あるいは外界からどのような信号を受け取っているかは、ここでは情報と考えません(extrinsic information)。

内的な情報、についてより詳しく説明すると、IITでは「現在の状態が、過去と未来の情報に対してなんらかの因果関係があること」が内的な情報だとします。たとえば2つの値を受け取って加算した結果を表示するような単純な機械を考えます。これは外部の情報を受け取って加算し、ただ表示しているだけなので、これが加算であろうと複雑な方程式を解くものだろうと情報はゼロとします。同様に考えると、サーモスタットにも情報は生じないし、意識も生じないことになります*19。

IIT - 情報統合

統合(integration) は、文字通り複数の情報を統合してひとつにすることです。IITでは、「意識は情報が統合されたときに生じる」と考えます。どれだけシステム内部で複雑な計算をしたとしても、それらの情報が統合されなければ意識は生じないとするのです。

IIT - 統合情報量φ

統合情報量というものを考え、これをφ(ギリシャ文字のファイ)で表します。φは情報統合理論を知る上で欠かせない中心的な概念です。

φは、システムを分割したときにどれくらい情報が失われるかで表します。意識がないものはそのシステムを2つに分割しても内部の情報処理になんの影響ももたらさない一方で、意識があるものはそのシステム(脳)を分割すると瞬く間に機能しなくなってしまう、ということです。

そして、最大のφを生み出すシステムの組み合わせが意識になる、というのがIITにおける「意識とは何か」に対する回答です。IITではこの組み合わせをコンプレックス(complex)と呼びます。

なぜこのようなことを考えるのかというと、たとえば二人の人間が会話をしているところを想像してみましょう。ここでは言語によって二人の人間がお互いに情報をやり取りし、かつ内部で情報処理を行っています。情報統合について考えると、この二人でひとつの意識があることになりますが、それはちょっと受け入れがたい結論です。そこでコンプレックスについて考えると、この二人で一つの意識として考えるより、個々の人間が一つずつの意識を持っているとしたほうがφが大きくなります。φの最大化を考えることで、人間同士の意識が別個に保たれることを保証しているのです。

もうひとつ実用的な例を出すと、分離脳についても情報統合理論である程度説明することができます。

普段は大脳の左半球と右半球は脳梁によって接続されており、ひとつの意識を形成しています。外科手術によって脳梁を分離すると分離脳の状態となり、左半球と右半球で別々の意識が生じたかのような振る舞いをし始めます。これは、脳梁によって接続された2つの大脳半球のφが大きいので通常は一つのシステム(一つの意識)として動くのですが、分離脳になると右半球でひとつ、左半球でひとつのシステム(意識)であるほうがφが大きくなるので、別個に意識が生まれるとするのです*20。

それでは具体的にあるシステム(たとえば動物の脳)のφをどうやって計算してコンプレックスを見つけるのかという点ですが、これは計算量的にほとんど不可能で、非常に小さいシステムでしか測れないという問題があります。なんらかの近似はできるかもしれませんが……。とはいえ、意識を測る基準を設けたという点では大きな進歩です。 トノーニは近年も活発にIITについての研究成果を発表しているので、気になる方は調べてみてください。

- 作者: ジュリオ・トノーニ,マルチェッロ・マッスィミーニ,花本知子

- 出版社/メーカー: 亜紀書房

- 発売日: 2015/05/26

- メディア: 単行本

- この商品を含むブログ (7件) を見る

より大局的なモデル

最終日ということで、せっかくなので私の考えも含めてお話します。私は大脳皮質のモデル化より、小脳や大脳基底核のほうに興味があり、これらも含めた包括的なアーキテクチャを考えています。

生理学的な知見から、大まかには上図のような3つのループがある構造になっていると考えています。つまり、視床→大脳皮質→大脳基底核→視床というループと、視床→大脳皮質→小脳→視床というループと、視床→大脳皮質内→視床という3つから成ります*21*22*23。

大脳基底核は強化学習によって自己の利益を最大化しようとし、小脳は外界や自己を含めた世界の内部モデルを教師あり学習によって構築するのが役割です。大脳皮質は教師なし学習で外界から得た情報から有用な情報を抽出し、より高度な、あるいは抽象的な概念の獲得を目的とします。大脳基底核や小脳の構造が種によってさほど変化がない一方で、ヒトの大脳皮質は非常に大きいというのもこの考えに一致するところがあります。

未解決の問題

まだわかっていないところは挙げていったらキリがありませんが、特にAGI研究においてまだ不十分な部分を主要なものに絞って挙げると以下の様なものがあります。

脳のDefault Mode Network はなにをしているか

脳は「なにもしてないとき」つまりぼーっとしているときにかなり活発に活動していることがわかっています。これをデフォルトモードネットワーク(Default Mode Network)と呼びます。神経細胞を活動させるのにはエネルギーが必要なので、普通に考えると何も考えてないのならなるべく神経の活動を抑えるほうが理にかなっています。にもかからわずデフォルトモードネットワークのような活動があるということは、たとえエネルギー消費量が多くなってもやる価値がある処理、というわけです。一般には「次に何かが起きた時に素早く反応できるようにしておく」という説が主流ですが、その割にはエネルギー消費が大きすぎるという問題もあります。

大脳皮質のコラムは何を計算しているのか

大脳皮質は Deep Learning 研究で特に一次視覚野と似たようなニューロンを獲得したことから、「大脳皮質はDeep Learningなのではないか?」と言われることもありますが、実際の大脳皮質はもっと複雑な構造をしており、1つのコラムが様々な処理をしていることは明らかです。コラムは大脳皮質の最小処理単位と考えられているので、コラムの計算機構を明らかにするのは重要な課題です。

注意のモデル化

脳科学における注意(attention)というのは、意識をそこに向けるというだけでなくもう少し広い意味を持っていますが、注意によって大脳皮質の特定の活動だけを反応させやすくする機構があるようです。これは大脳の高次の領野から低次の領野への接続がかかせませんが、たとえばDeep Learningにはこのようなメカニズムはありません。そもそも注意の大元はどこからくるのか?意識なのか?もっと別の仕組みなのか?もよくわかっていません。

アウェアネス

どうするとある感覚について意識に登ってくるのかもよくわかっていません。たとえば盲視と呼ばれる状態は、その人自身は「何も見えない」と思っている状態ですが、たとえば目の前にあるものを勘で手に取るようなタスクを行うと、偶然とは思えない確率で成功します。意識に上るか上らないかはなにによって決まるのか、なぜ盲視が起きるのかは意識にも絡み重要な問題です。

ミラーニューロンはどのように獲得されるか

ミラーニューロン*24は自分が行うときも、他人が行うときも同じように反応するニューロンです。たとえば自分が物をつかむときに反応し、かつ他人が物をつかむところを見ているときも同様に反応するニューロンがあるのです。このようなニューロンがどのように生まれるのかはよくわかっていません。後天的に獲得されるものもあるようですが、生まれたばかりの個体でも表情を真似たりできることから、単に教師あり学習や強化学習的なものではないようです。ミラーニューロンは学習における重要な役割を果たす「模倣」に不可欠だと考えられているため、ミラーニューロンの神経基盤を知ることはAGI研究の大きな手がかりになります。

ミラーニューロンの発見―「物まね細胞」が明かす驚きの脳科学 (ハヤカワ・ノンフィクション文庫)

- 作者: マルコイアコボーニ,Marco Iacoboni,塩原通緒

- 出版社/メーカー: 早川書房

- 発売日: 2011/07/08

- メディア: 文庫

- 購入: 5人 クリック: 14回

- この商品を含むブログ (11件) を見る

バインディング問題

バインディング問題は、脳内ではバラバラに処理されているはずの情報が、正しく統合されて知覚されるのはなぜかという問題です。たとえば色を認識する領野、形を認識する領野、動きを認識する領野は異なります。そのため、たとえば「右に動いている赤い四角形」と「左に動いている青い三角形」があったとき、最初のうちは「右に動いている」「左に動いている」「赤い」「青い」「四角い」「三角」といった情報がバラバラに処理されているはずです。ですが最終的にはきちんと正しい組み合わせになって意識に上り、混乱することはありません。バインディング問題が起きずにどんなときも常に正しく知覚できるということは、これが高度な処理ではなく大脳皮質のかなり基本的な原則によって成されていると考えられますが*25、あまりわかっていません*26。

さいごに

25日にわたって、汎用人工知能に必要なごく基本的な知識について紹介しました。どの日の記事をとっても、書いたのは本当に表面的なことだけで、実際にはもっと多くのことがわかっていますし、理論的なバックグラウンドがあります。ただ、より多くの方に汎用人工知能とはなにか?今までに何がわかっていて、これからはどのような取り組みをしていくのか?を紹介できたらなという思いでなんとか25日連続で更新することができました。

別の目的としては、筆者もまたAGIの研究開発をしているひとりであり、行き詰ったところで頭の中の整理をしようと思ったという点もあります。基本的にこのアドベントカレンダーは私が今までに実装したり調査したりしたものが中心となっていますが、いざ書き出していくと意外とわかっていないこともあるものです。

また、どうにも世界にはAGIを研究している人があまり多くないようで、私のような方が他にも見つかればいいなと思ったのもモチベーションになりました。

今回ご紹介しきれなかったもの、より多くの注釈や解説が必要なもの、数学的なモデルを含めた紹介*27、色々未練があるので、そのうち加筆修正したものを電子書籍かなにかにするかもしれません*28。そのときはまたよろしくお願いします。

それでは。

*1:Wiskott, L. and Sejnowski, T. Slow feature analysis: unsupervised learning of invariances. Neural Computation, 14(4):715--770, 2002.

*2:Aapo Hyvärinen, Patrik O. Hoyer, and Mika Inki, Topographic Independent Component Analysis, Neural Computation 13(7):1527-1558, 2001

*3:Terashima, H. and Hosoya, H.: Sparse codes of harmonic natural sounds and their modulatory interactions, Network: Computation in Neural Systems, Vol. 20, No. 4, pp. 253–267, 2009

*4:寺島裕貴, 岡田真人, 視覚野・聴覚野地図の同一適応アルゴリズムによる解釈 から引用

*5:Rosenblatt 1958

*6:Ramelhart 1986

*7:Buonomano DV and Maass W. Statedependent computations: spatiotemporal processing in cortical networks. Nature Rev Neurosci 10:113–125. 2009

*8: Jaeger H, Maass W, and Principe J. Echo State Networks and Liquid State Machines, Volume 20 of Neural Netw. 2007

*9:Marr D. A theory of cerebellar cortex. J Physiol (Lond) 202:437–470. 1969

*10:Ito M. Long-term depression. Annu Rev Neurosci 12:85–102. 1989

*11:Yamazaki T and Tanaka S. The cerebellum as a liquid state machine. Neural Netw 20:290–297. 2007

*12:Wolfram Schultz. Predictive Reward Signal of Dopamine Neurons. Journal of Neurophysiology Published 1 July 1998 Vol. 80 no. 1, 1-27

*13:Samejima K1, Ueda Y, Doya K, Kimura M. Representation of action-specific reward values in the striatum. Science. 2005 Nov 25;310(5752):1337-40.

*14:Volodymyr Mnih, Koray Kavukcuoglu David Silver, Alex Graves, Ioannis Antonoglou, Daan Wierstra, Martin Riedmiller. Playing Atari with Deep Reinforcement Learning, NIPS Deep Learning Workshop 2013.

*15:ただ、Hawkins自身はこれは脳を完全にシミュレートすることを目指すのではなく、脳の処理を模倣することでより柔軟なマシンを作るといった方向でいる

*16:Hawkinsはよく「名前をつける」と表現している

*17:一杉裕志, 大脳皮質とベイジアンネット, 日本ロボット学会誌 Vol.29 No.5, pp.412-415, 2011 https://staff.aist.go.jp/y-ichisugi/besom/29_412.pdf から引用

*18:Tononi G. An information integration theory of consciousness. BMC Neurosci.2004 Nov 2 ; 5():42.

*19:なぜ急にサーモスタットの話をしたのかというと、デビッド・チャーマーズが「どんなものにも多かれ少なかれ意識があるとするなら、サーモスタットは外界の気温という情報を受け取って、自身の温度を変化させて環境を一定に保つ能力があるので、十分に意識があるといえることになる」旨の発言をしたので、サーモスタットの例はよく引き合いに出される

*20:この理論が正しい場合、少しずつ脳梁を切断していくと、ある閾値を超えた瞬間に突然左右の半球に2つの意識が生じることになるが、このような実験は難しいので実証はされていない

*21:Alexander GE, Crutcher MD. Functional architecture of basal ganglia circuits: neural substrates of parallel processing. Trends Neurosci 1990; 13: 266-271.

*22:Hikosaka O, et al. Role of the basal ganglia in the control of purposive saccadic eye movements. Physiol Rev 2000; 80: 953-978.

*23:Takakusaki K, Habaguchi T, Ohinata-Sugimoto J, et al. Basal ganglia efferents to the brainstem centers controlling postural muscle tone and locomotion: a new concept for understanding motor disorders in basal ganglia dysfunction. Neuroscience 2003; 119: 293-308

*24:Giacomo Rizzolatti et al. Premotor cortex and the recognition of motor actions, Cognitive Brain Research 3 131-141. 1996

*25:仮に脳のどこかの領域でバインディング問題を解いている専用の場所があるとしたら、その部分の障害でバインディング問題を解けない人が出てくるはずだが、そういった人がいない

*26:脳波の位相によって表現されているのではないかという説が多い

*27:特にSVMのあたりが適当過ぎるので、カーネルトリックも含めた解説

*28:売れるだろうか?