小脳のモデル

これは 人工知能アドベントカレンダー の23日目の記事です。

小脳は文字通り大脳と比べると小さな器官で、多少損傷してもなめらかな運動ができなくなるといった程度で、昔は運動の微調整のための器官であると思われていました。

しかし、脳全体の1割程度しかない重さの小脳は、脳全体の8割のニューロンを有しているのです*1。「ニューロンが脳の処理の最小単位」であると仮定すれば、脳での処理の8割は小脳によって成されるといえます。さらに小脳は脊椎動物ならどの種であっても大きさが異なるだけで同じ構造をしています。

つまり、脳は動物における高度な情報処理において極めて重要かつ普遍的ななにかをしていると考えられますから、大脳基底核同様AGI研究においては極めて重要な部位だといえます。

小脳のおさらい

小脳については、アドベントカレンダー6日目で紹介しました。こちらも併せてご覧ください。

kazoo04.hatenablog.com

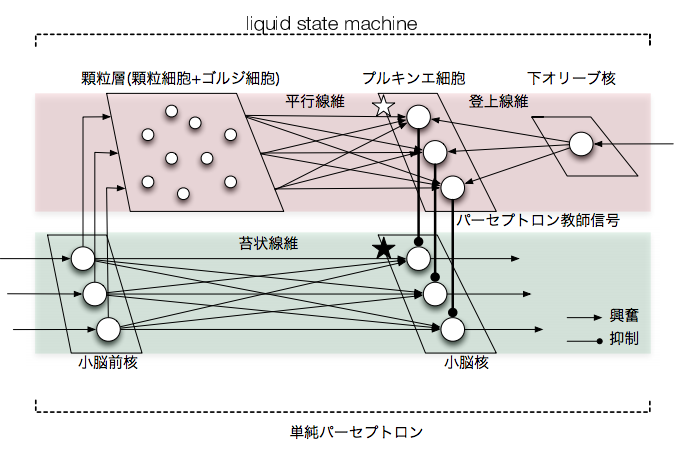

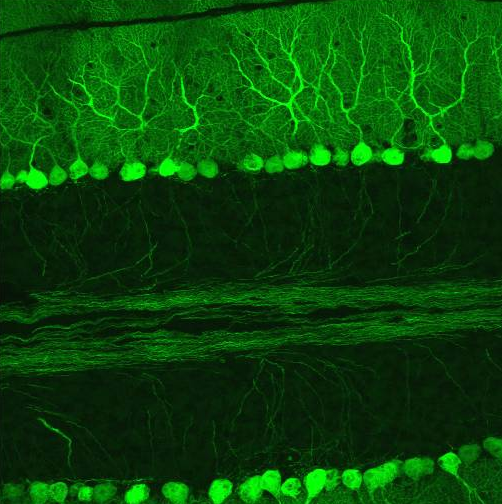

小脳特有の構造としては、下図のような3層構造がどこを見ても均一に、整然と並んでいるという点にあります。大脳新皮質はこれまで見てきたように、非常に複雑なネットワークがあり、また低次の領野から高次の領野へと情報が伝達されてより高度な情報処理が行われていると考えられています。

一方で小脳を見ると意外とシンプルで、この層構造がずっと続いているだけです。もう一つの興味深い点は、顆粒細胞同士、ゴルジ細胞同時、あるいはプルキンエ細胞同士の接続はなく、情報はかならず別の層へと伝わっていく点です。

小脳の障害を観察する

「小脳が何をしているか?」は、「小脳が傷つくと何ができなくなるか?」によって探すことができます。

運動障害

小脳が障害されると、ぎこちない動きしかできなくなったり、なめらかに歩行したりすることができなくなる、ということは1950年代には既に知られていました。その後もなめらかな運動が障害されるという知見は蓄積されていき、

- 「目標物に指で触れる」といったタスクで、目標物を通りすぎてしまったり、手前で止まってしまったりといった測定障害(dysmetria)

- 決められたリズムで同じ行動を何度も行うことが難しくなる(特に早く動かすときに顕著)、変換運動障害(dysdiadochokinesis)

- 同時に身体の複数の部位を動かすことが難しくなり、別々に動かしてしまう共同運動障害(dyssynergia)

などが知られていました。

小脳のモデル

それでは小脳は具体的に何を計算している器官なのでしょうか。今まで見てきたように、小脳は内部でのフィードバックもない単純な3層のネットワークしかありません。基本原理は比較的単純なもののはずです。今まで上げてきたタスクに共通する何かはなんでしょうか。

内部モデル

比較的古くから支持されている理論は、「内部モデルの教師あり学習」です。内部モデルの学習を仮定すると、今まで挙げてきたどのタスクも比較的うまく説明できます。

まず内部モデルについて説明します。内部モデルは順モデルと逆モデルの2つがあります。

順モデル (forward model)

順モデルの意味は比較的簡単で、原因から結果を予想するようなものです。より詳しく言えば、「この筋肉にこのくらいの信号を送れば、実世界ではこのような結果が起きるだろうな」という予想をするモデルです。フィードフォワード制御とフィードバック制御を合体させたような概念です。たとえば、自分自身をくすぐっても、くすぐったくありません。これは、どう指を動かすかという指令を送るときに、「こう指を動かしたのだから、身体からはこんな感覚が返ってくるだろう」という予想を内部モデルを使って行うからです。

逆モデル (backward model)

逆モデルは、文字通り順モデルの逆で、結果から原因を予想するものです。とはいってもわかりにくいと思うので、もう少し詳しく説明します。

よく挙げられる例としては、視覚から外界を予想することがあります。網膜上に入ってきた時点で視覚情報は2次元になっていますが、外界は3次元で、自分がいるのも3次元なので、たとえば前方にあるドアノブに手を伸ばすときは2次元の情報を元に3次元空間を動かないといけません。「3次元空間のある位置から目で見たとき、どう見えるか?」は完全に推定可能ですが、逆は必要な情報が欠けているので完璧に行うのは不可能です。これを不良設定問題(ill-posed problem)といいます。

目標物に向かって手を伸ばすとき、手の軌道は無数にあるのにもかかわらず最適(=なんらかの基準において最適と思われる)な軌道を選択するのも不良設定問題のひとつです。これも「こうありたい=目標物に触れたい」という結果から、あるべき運動(=どの筋肉をどのタイミングでどれくらい動かすか)を決めなければならない逆モデルがないといけません。

内部モデルは意識に上らないのでいまいち実感しにくいと思いますが、たとえば3Dのテレビゲームをするときに、コントローラーの「上キー」*7を押すと、キャラクターが「前」に進みます。このとき、まずキャラクターの3次元的な位置を2次元のディスプレイを見て推定し、さらに自分自身がそのキャラクターと同じ場所にいるかのように感じます。さらに、前に進みたいと思ったときには自分自身が前に進んでしまうのではなく、親指を動かしてコントローラーの上を押すわけです。ここでは、ゲームとコントローラーを自分自身の内部モデルに取り込んでいるのでなんの不自由もなくキャラクターを動かすことが出来るというわけです。

もっと身近な例では、マウスを動かすときも、ポインタを「上」に動かしたいときはマウスを「前」に動かさなければなりません。また、ディスプレイに対して手が斜めになっているときは、真上に動かしたくてもマウスはそれに合わせて若干斜め方向に動かす必要がありますが、通常このような計算は最初の数秒だけ戸惑うかもしれませんが、その後はすぐに無意識化で行われます。

テニスラケットでボールを打ち返す時も、自分の手より数十cmほど手が伸びたかのように腕を動かさないとラケットではなく自分の指にボールがあたってしまいますが、このようなミスをすることなく人間はすぐに順応できます。車の運転からUFOキャッチャーの操作まで、「外界にあるものを自分の体の延長として扱う」ようなタスクは数多くありますが、非常に複雑な計算も意識することなく瞬時に慣れることができるのは驚異的なことで、ロボットには殆どできません。

このようなモデルの構築について小脳が大きな役割を果たしている、と考えられています。

ここまでのまとめ

ここまでの話をまとめると、小脳は自分自身や外界を含めた様々なモデルを構築し、保持し、必要に応じて入力を変換して返せるような器官になっていると考えられます。

この世のものは様々な法則によって動いており、等速直線運動のような単純な動きから、飛ぶ鳥のような複雑でノイズも含まれる動き、マウスの動かし方や安定して歩く方法のような身近なもの、2次元の情報から3次元形状を復元するような不良設定問題という本質的に解けないような問題もあります。

これらがすべて小脳のあの単純な構造から計算されているということは、小脳はとてつもなく万能なシステムということになります。本当にそんな万能なものが実現できるのでしょうか。

教師あり学習

次に教師あり学習ですが、これは先日説明しました。

これはいくつかの例題とその答えを用意しておくと、そのうち正解がなくても上手く問題が解けるようなアルゴリズムです。テニスの例でいえば、初めてテニスをやるときはラケットを振って思ったように弾が打ち返せなくても、何度かやってるうちに上手く出来るようになり、最終的には特に意識しなくても自然に飛んできたボールを打ち返せるようになる、といった具合です。

今までのどの例でも、「上手くいったかどうか?」というフィードバックがあって初めて成り立つタスクです。マウスを動かす時も、思っているのと少し違う方向に動いたら「おや、思っているのと違うぞ」と思うわけです*8。これが教師信号となって小脳に伝達され、正しい回答(動き)が得られるようにモデルが修正されるのです。

自転車をこぐときも、ぐらぐらして転倒してしまったら、「痛い、悔しい、失敗した」と思うことが教師信号になり、失敗しないようなモデルが構築され、最終的には転倒せずに自転車に乗れるようになる、と考えます*9。

小脳パーセプトロン仮説

小脳のモデルで最も有名なのは、小脳パーセプトロン仮説*10*11です。

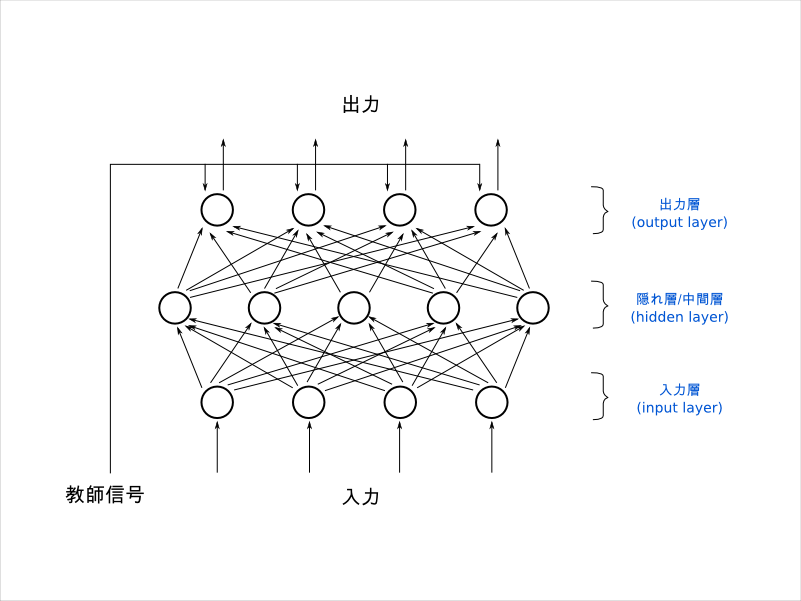

これは文字通り小脳はパーセプトロンである、という仮説*12です。パーセプトロンについては15日目に説明しました。

下の図は最初にも提示した小脳の構造です。

パーセプトロンは下の図です。

ちょっと無理がある気もしますが、似ているといえばそうも見えます。この説を支持するためには

- 教師信号か誤差信号が送られてきていること

- 送られてきた信号によってネットワークの重みが変わり、それが維持されること

は少なくとも示す必要があります。Itoらは、図で示した一番上のプルキンエ層、平行線維とプルキンエ細胞との間に長期抑圧(LTD)という現象が起きること、下オリーブ核から投射される途上繊維に誤差信号が含まれていることを発見し、このパーセプトロン仮説はかなり説得力を持つことになります。

さらに洗練されたモデル

とはいえ、たったそれだけの証拠で小脳=パーセプトロンとは結論できません。「パーセプトロンのような」仕組みにはなっていそうですが、より洗練されたモデルが必要です。それに下オリーブ核の仕組みも解明しなければ、「どのようにして教師信号を得ているのか」という重要な部分もわかりません。

後者についてはあまりわかっていないのですが、小脳パーセプトロン仮説をもとに様々なモデルが提案されています。

なぜ3層のモデルを採用したか

これまで見てきたように、ニューラルネットワークは多層にすると表現能力が上がります(= Deep Learning)。実際に大脳新皮質は多層のネットワークを使って高度な情報処理をしているようです。それなら、小脳も3層ではなくもっと層を増やせば性能向上が見込めそうです。なぜ浅いネットワーク(shallow network)を獲得しているのでしょうか。

ここからは筆者の推測がまじりますが、これはいくつかの理由が考えられます。最大の理由はおそらく処理速度の点ではないかと考えられます。コンピュータと異なり、ニューロンの反応速度は非常に遅く、数十Hzしか出ません。コンピュータのトランジスタが数GHz(1GHz = 1,000,000,000Hz)で動作することを考えると相当な遅さです。このような素子を多層に(直列に)繋ぐと、結果が得られるまでの時間がどんどん伸びてしまいます。情報をとっさに処理できないのは動物としては致命的な問題になりうるので、直列ではなく並列に計算したほうが有利です。

一方で、層を浅くするとネットワークの表現能力が落ちるため、これを補うために中間層(隠れ層)のノード数(ニューロン数)を大幅に増やす必要があります。これが小脳に大量の顆粒細胞がある理由だと思われます。大脳新皮質ほど高度な処理はできないけれど、処理ユニットを超並列化して、任意の関数の近似を非常に高速に行う、というのが小脳の役割というわけです。

コンピュータに例えて言うなら、大脳新皮質は様々な高度な処理が柔軟にできるかわりに速度はある程度のところで頭打ちになってしまうCPUで、小脳はある程度決まったことしかできないけれど、コア数がものすごく多くて並列計算するので非常に速いGPU、といったところでしょうか。

まとめ

小脳は構造が比較的単純な割に、脊椎動物に共通して見られることから古くから精力的に研究されてきました。そのおかげで脳の他の部位と比べかなりモデル化が進んでいます。今回紹介したLSMベースのモデルのほかにも様々な手法が研究されていますが、基本的には小脳パーセプトロン仮説を基盤としているものが多いようです。

ニューラルネットワークとしてかなり早い段階から提唱されてきたパーセプトロンが、動物にとって基本的かつ重要な役割を持つ小脳のモデルとして適切であるということは非常に面白い流れだと思います。小脳研究は現在もかなり活発に進んでいるため、モデルもさらに洗練されていくはずなので、今最も脳の模倣に近いところにいるのは小脳なのではないでしょうか。

今回で各部位の解説、モデルの紹介は一通り終わりました。次回以降は今まで紹介してきたものを統合しつつAGIを実現するために必要なものについてあらためて考えてみましょう。

*1:さらに詳しく見ると、このニューロンのほとんどは顆粒細胞で、顆粒細胞だけで脳全体の7割を占める

*2:たとえば、"nail(釘)"に対して"hammer(打つ)"、"boat(ボート)"に対して"row(漕ぐ)"と答えるというもの。ただし問題は1.5秒に1回とかなり高速に出るので、最初のうちはうまくいかない。ただし練習すると次第にうまくなる。この研究ではその仮定で活動する脳の位置が異なってくることを発見した

*3:Raichle ME, Fiez JA, Videen TO, MacLeod AM, Pardo JV, Fox PT, Petersen SE. Practice-related changes in human brain functional anatomy during nonmotor learning. Cereb. Cortex, 4, 8-26, 1994.

*4:図を見た時に頭の中でその図を回転させたイメージをすること

*5:Gao JH, Parsons LM, Bower JM, Xiong J, Li J, Fox PT. Cerebellum implicated in sensory acquisition and discrimination rather than motor control. Science. 1996 Apr 26;272(5261):545-7.

*6:Grafman J, Litvan I, Massaquoi S, Stewart M, Sirigu A, Hallett M. Cognitive planning deficit in patient with cerebellar atrophy. Neurology. 1992 Aug;42(8):1493-6.

*8:実際にはマウスを動かすたびに小脳によってモデルの学習が行われていたらマウスの位置がちょっと変わる度に何度も練習しなければならないため例としては不正確である。実際には、「マウスがこのように置かれていてポインタがこのように動くなら、これくらいの角度で動かす」という包括的なモデルが構築されるため、どのような環境でも正しくポインタを動かせると考える

*9:スポーツにおける練習も、ただ漠然と数をこなすだけではあまりうまくならず、自分のフォームなり結果なりを逐次振り返りながら行ったほうが効果が高い、というのは小脳に良質な教師信号を送れているかどうか、という違いなのかもしれない

*10:David Marr. A theory of cerebellar cortex. Journal of Physiology 202: 437-470. 1969.

*11:M Ito. Climbing fibre induced depression of both mossy fibre responsiveness and glutamate sensitivity of cerebellar Purkinje cells. Journal of Physiology 324: 113-134. 1982.

*12:ここではただのパーセプトロンではなく、バックプロパゲーションのようなものを指している

*13:LSMベースの手法は、特にスイス連邦工科大学と電気通信大学で精力的に活動しておられる方がいるようだ。たとえば Guillaume Hennequin や 山崎匡 など

*14:学習の必要がないので速い、過学習しにくい、様々な特徴の組み合わせを生成し非線形分離しやすくする、適当で良いので生体的にも構築が楽で頑健、など。似たアルゴリズムにEcho State Network(ESN)があるが、数学的にはほとんど等価

*15:山崎 匡, 永雄 総一. 運動記憶の転送を行う小脳のスパイキングネットワークモデル. 日本神経回路学会 2008年9月